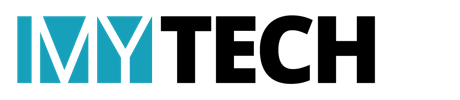

X(Twitter) မှာ AI နဲ့ ပြုလုပ်ထားတဲ့ ညစ်ညမ်း ဓါတ်ပုံတွေ ထွက်လာပြီးနောက် X မှာ Taylor Swift ကို ရှာလို့ မရအောင်ပြုလုပ်ခဲ့ရပါတယ်။ “Taylor Swift AI” လို့ X မှာ ရှာရင် “Something Went Wrong” ဆိုတဲ့ စာသားကို မြင်ရပါတယ်။ X ရဲ့ စီးပွားရေးလုပ်ငန်းဌာနမှ အကြီးအကဲ Joe Benarroch က အခုလို ယာယီပိတ်ပင်ထားတာလို့ အတည်ပြုပါတယ်။

:format(webp)/cdn.vox-cdn.com/uploads/chorus_asset/file/25251852/Screenshot_2024_01_27_at_12.57.18_PM.png)

Taylor Swift ရဲ့ ညစ်ညမ်းဓါတ်ပုံတွေ ထွက်လာပြီးနောက်မှာ X က အဲဒီဓါတ်ပုံတွေကို ဖျက်နေပြီး ဓါတ်ပုံတင်တဲ့ အကောင့်တွေကို အရေးယူနေတယ်လို့ ကြေညာခဲ့ပါတယ်။ X ရဲ့ မူဝါဒမှာ လူတွေကို နစ်နာစေတဲ့ ညစ်ညမ်းဓါတ်ပုံတွေ တင်တာကို ပိတ်ပင်ထားပါတယ်။

:format(webp)/cdn.vox-cdn.com/uploads/chorus_asset/file/25251905/Screenshot_2024_01_27_at_1.32.30_PM.png)

Meta ကလည်း အဲဒီပြဿနာကို ကိုင်တွယ်နေတယ်လို့ ထင်ရပြီး Threads နဲ့ Instagram မှာ Taylor Swift ကို ရှာရင် ဘာမှ မပြသပေးဘဲ ပိတ်ခဲ့ရပါတယ်။ အဲဒီလို ရှာရင် အန္တရာယ်ရှိတဲ့ အဖွဲ့အစည်းနဲ့ လူတွေရဲ့ လုပ်ရပ်တွေနဲ့ ပတ်သက်နေတဲ့ Term ဖြစ်တယ်လို့ ဖော်ပြထားပါတယ်။

Taylor Swift ဟာ သူ့ရဲ့ ညစ်ညမ်း ဓါတ်ပုံတွေ တင်ထားတဲ့ ဝက်ဘ်ဆိုက်တွေကို တရားဥပဒေနဲ့ အရေးယူဖို့ စဉ်းစားနေတယ်လို့ သတင်းထွက်နေပါတယ်။ Microsoft CEO Satya Nadella က NBC Nightly News နဲ့ သောကြာနေ့က အင်တာဗျူးမှာ AI ကုမ္ပဏီတွေဟာ လူတွေ ဘေးကင်းစေမယ့် အစီအစဉ်တွေကို အမြန်ဆုံး ပြုလုပ်သင့်တယ်လို့ ပြောသွားပါတယ်။ အိမ်ဖြူတော်ရဲ့ အတွင်းရေးမှူး Karine Jean-Pierre က Deepfake Porn ကနေ လူတွေကို ကာကွယ်ဖို့ ဥပဒေတွေ ရေးဆွဲသင့်တယ်လို့ ပြောပါတယ်။

Ref: theverge