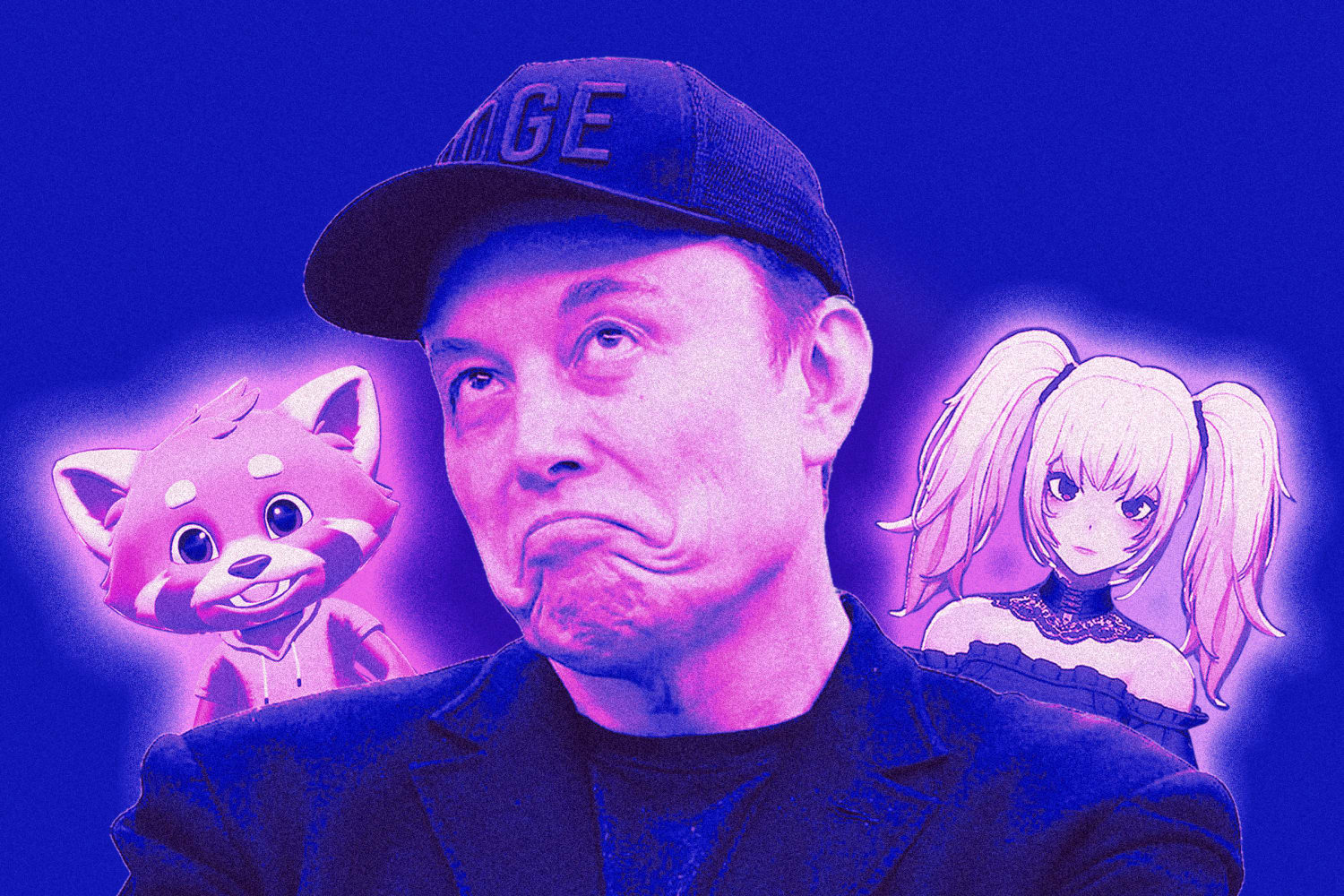

Elon Musk ရဲ့ Grok AI ဟာ ၁၁ ရက်အတွင်း လိင်ပိုင်းဆိုင်ရာ ပုံရိပ်ပေါင်း ၃ သန်းလောက် ဖန်တီးပေးခဲ့ပြီး အဲဒီထဲမှာ ကလေးငယ်ပုံစံ ပုံရိပ်ပေါင်း ၂၃,၀၀၀ ပါဝင်နေတယ်လို့ သုတေသီတွေက တွေ့ရှိခဲ့ပါတယ်။ Center for Countering Digital Hate (CCDH) ရဲ့ လေ့လာချက်အရ ဒီ AI ဟာ လိင်ပိုင်းဆိုင်ရာ စော်ကားမှုပုံရိပ်တွေ ထုတ်လုပ်ပေးတဲ့ စက်ကြီးတစ်ခုလို ဖြစ်လာခဲ့တယ်လို့ ဆိုပါတယ်။

ဒီ AI စနစ်မှာ သုံးစွဲသူတွေက လူစိမ်းတွေနဲ့ နာမည်ကြီး အနုပညာရှင်တွေရဲ့ ဓာတ်ပုံတွေကို တင်ပြီး အဝတ်အစားမဲ့ပုံစံ၊ ရေကူးဝတ်စုံပုံစံတွေအဖြစ် ပြောင်းလဲ ဖန်တီးနိုင်တာကြောင့် နိုင်ငံတကာမှာ ဝေဖန်မှုတွေ မြင့်တက်ခဲ့ပါတယ်။ Taylor Swift၊ Billie Eilish နဲ့ Kamala Harris အပါအဝင် နာမည်ကျော်ပုဂ္ဂိုလ်များစွာရဲ့ ပုံရိပ်တွေကို လိင်ပိုင်းဆိုင်ရာ ပြုပြင်ဖန်တီးမှုတွေ လုပ်ဆောင်ခဲ့ကြပြီး နှစ်သစ်ကူးကာလမှာ ဒီအသုံးပြုမှုက အမြင့်ဆုံး ရောက်ရှိခဲ့ပါတယ်။

ဒီကိစ္စနဲ့ပတ်သက်ပြီး ဗြိတိန်ဝန်ကြီးချုပ် Keir Starmer က ရွံရှာဖွယ်ကောင်းတယ်လို့ ဝေဖန်ခဲ့ပြီးနောက် ဇန်နဝါရီ ၉ ရက်နေ့မှာ ဒီစနစ်ကို အခပေးအသုံးပြုသူတွေအတွက်ပဲ ကန့်သတ်ခဲ့ပါတယ်။ အင်ဒိုနီးရှားနဲ့ မလေးရှားနိုင်ငံတွေက ဒီ AI tool ကို ပိတ်ပင်ခဲ့ပြီး နောက်ဆုံးမှာတော့ ဇန်နဝါရီ ၁၄ ရက်နေ့မှာ X ကုမ္ပဏီက လူအစစ်တွေရဲ့ ပုံတွေကို အဝတ်အစား ပြုပြင်ဖန်တီးပေးတဲ့ လုပ်ဆောင်ချက်ကို ရပ်ဆိုင်းလိုက်ပါတယ်။

CCDH ရဲ့ အမှုဆောင်အရာရှိချုပ် Imran Ahmed ကတော့ Elon Musk ဟာ ဒီလိုအလွဲသုံးစားမှုတွေ ဖြစ်နေတာကို သိလျက်နဲ့ လူတွေ စိတ်ဝင်စားမှုရဖို့ ထုတ်ကုန်ကို မြှင့်တင်ခဲ့တယ်လို့ ဝေဖန်ထားပါတယ်။ X ကုမ္ပဏီဘက်ကတော့ ကလေးသူငယ် လိင်ပိုင်းဆိုင်ရာ ခေါင်းပုံဖြတ်မှုနဲ့ ခွင့်ပြုချက်မရှိဘဲ အဝတ်မဲ့ပုံဖော်ပြမှုတွေကို လုံးဝသည်းခံမှာ မဟုတ်ကြောင်းနဲ့ စည်းကမ်းချိုးဖောက်တဲ့ အကောင့်တွေကို အရေးယူဆောင်ရွက်နေကြောင်း ပြန်လည်တုံ့ပြန်ထားပါတယ်။

Ref: theguardian